聚类包括将某些彼此相似的对象分组,它可用于确定两个项目的属性是相似还是不相似。

在数据挖掘的意义上,相似性度量是具有描述对象特征的维度的距离。这意味着如果两个数据点之间的距离很小,则对象之间的相似度很高,反之亦然。相似性是主观的,在很大程度上取决于上下文和应用。例如,蔬菜之间的相似性可以通过它们的味道、大小、颜色等来确定。

大多数聚类方法使用距离度量来评估一对对象之间的相似性或差异,最常用的距离度量是:

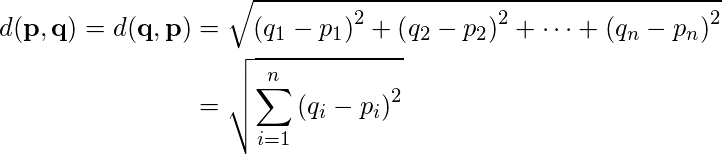

1.欧几里得距离:

欧几里得距离被认为是几何问题的传统度量。它可以简单地解释为两点之间的普通距离。它是聚类分析中最常用的算法之一。使用此公式的算法之一是K-mean 。从数学上讲,它计算两个对象之间坐标之间的平方差的根。

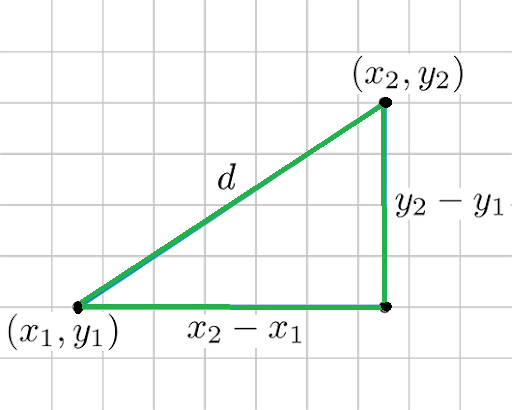

2. 曼哈顿距离:

这确定了坐标对之间的绝对差异。

假设我们有两个点 P 和 Q 来确定这些点之间的距离,我们只需计算这些点与 X 轴和 Y 轴的垂直距离。

在一个平面中,P 在坐标 (x1, y1) 和 Q 在 (x2, y2)。

P 和 Q 之间的曼哈顿距离 = |x1 – x2| + |y1 – y2|

这里红线的总距离给出了两个点之间的曼哈顿距离。

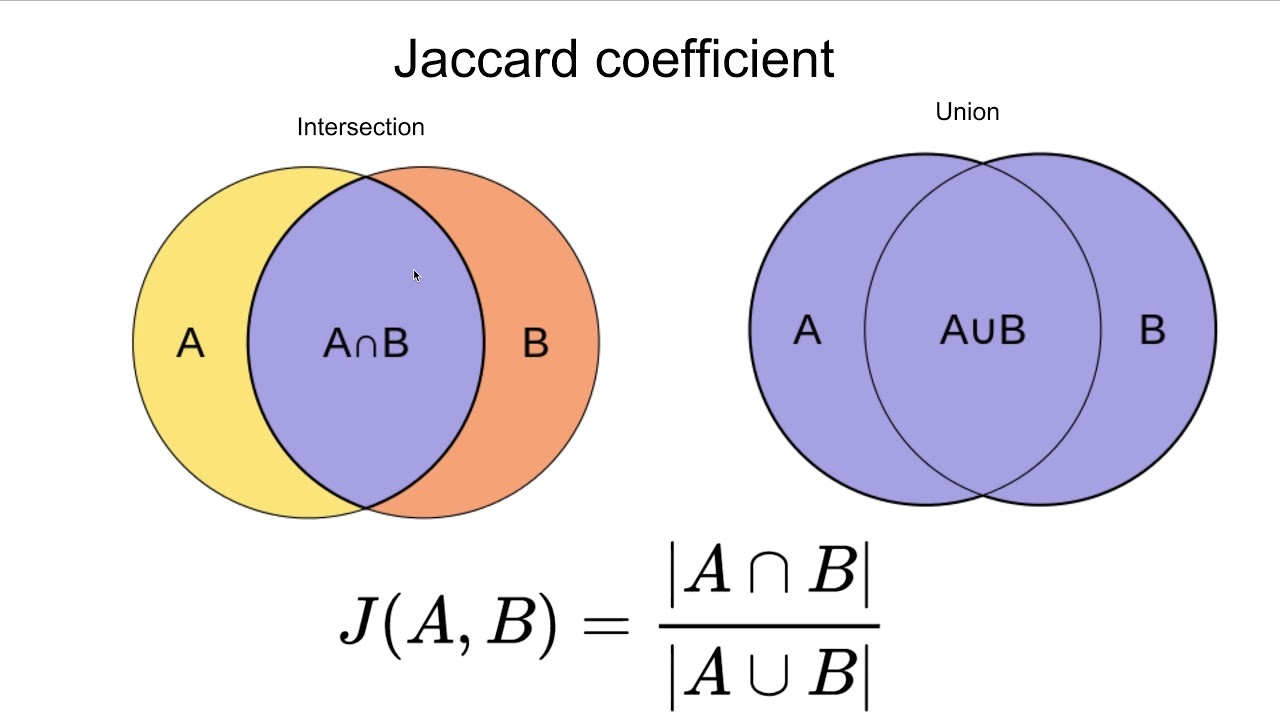

3.杰卡德指数:

所述的Jaccard距离测量两个数据的相似设置的项目如由数据项的结合分割这些项目的交叉点。

![]()

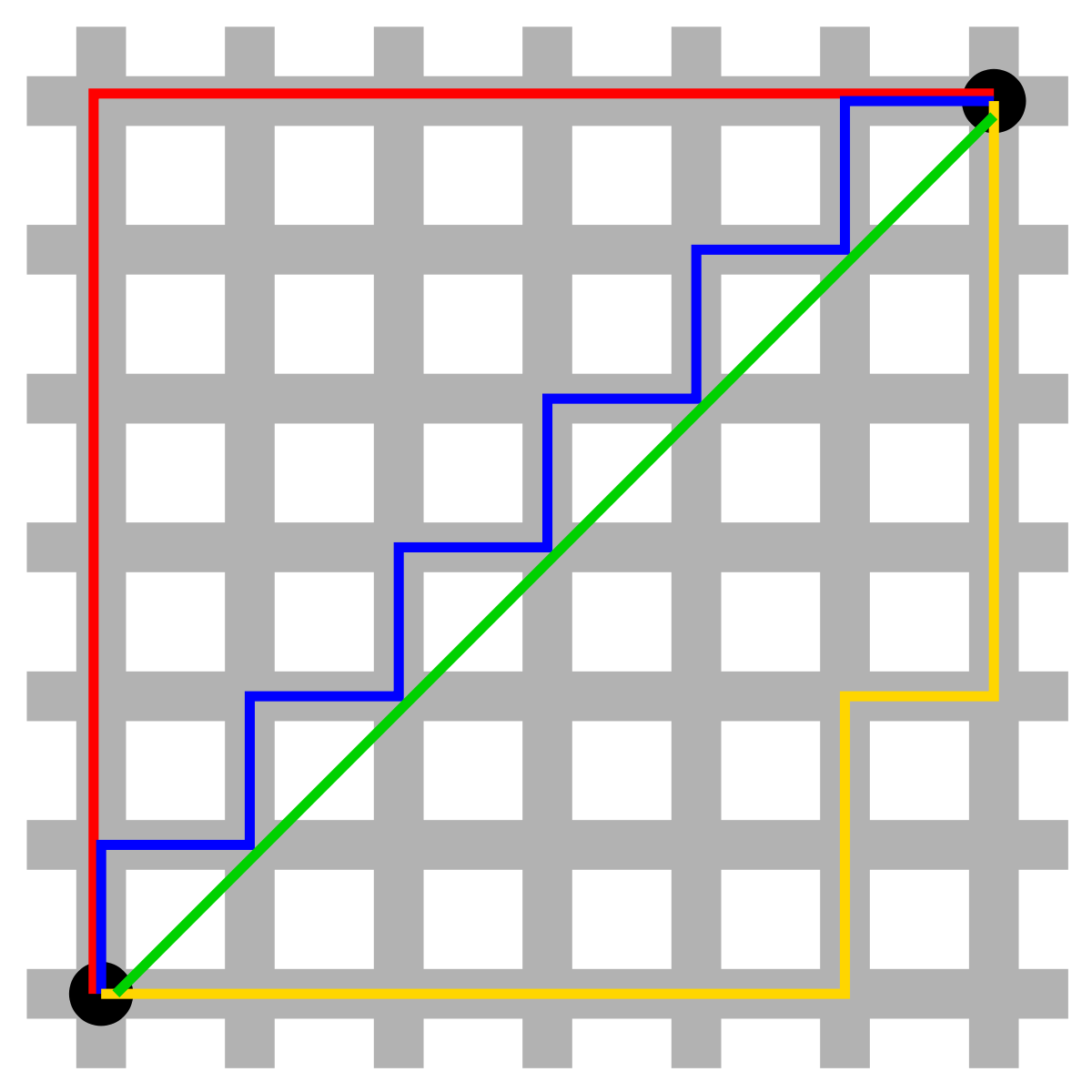

4.闵可夫斯基距离:

它是欧几里得和曼哈顿距离测度的广义形式。在N 维空间中,一个点表示为,

(x1, x2, ..., xN) 考虑两点 P1 和 P2:

P1: (X1, X2, ..., XN)

P2: (Y1, Y2, ..., YN) 然后,P1 和 P2 之间的 Minkowski 距离为:

![]()

- 当p = 2 时,闵可夫斯基距离与欧几里得距离相同。

- 当p = 1 时,闵可夫斯基距离与曼哈顿距离相同。

5. 余弦指数:

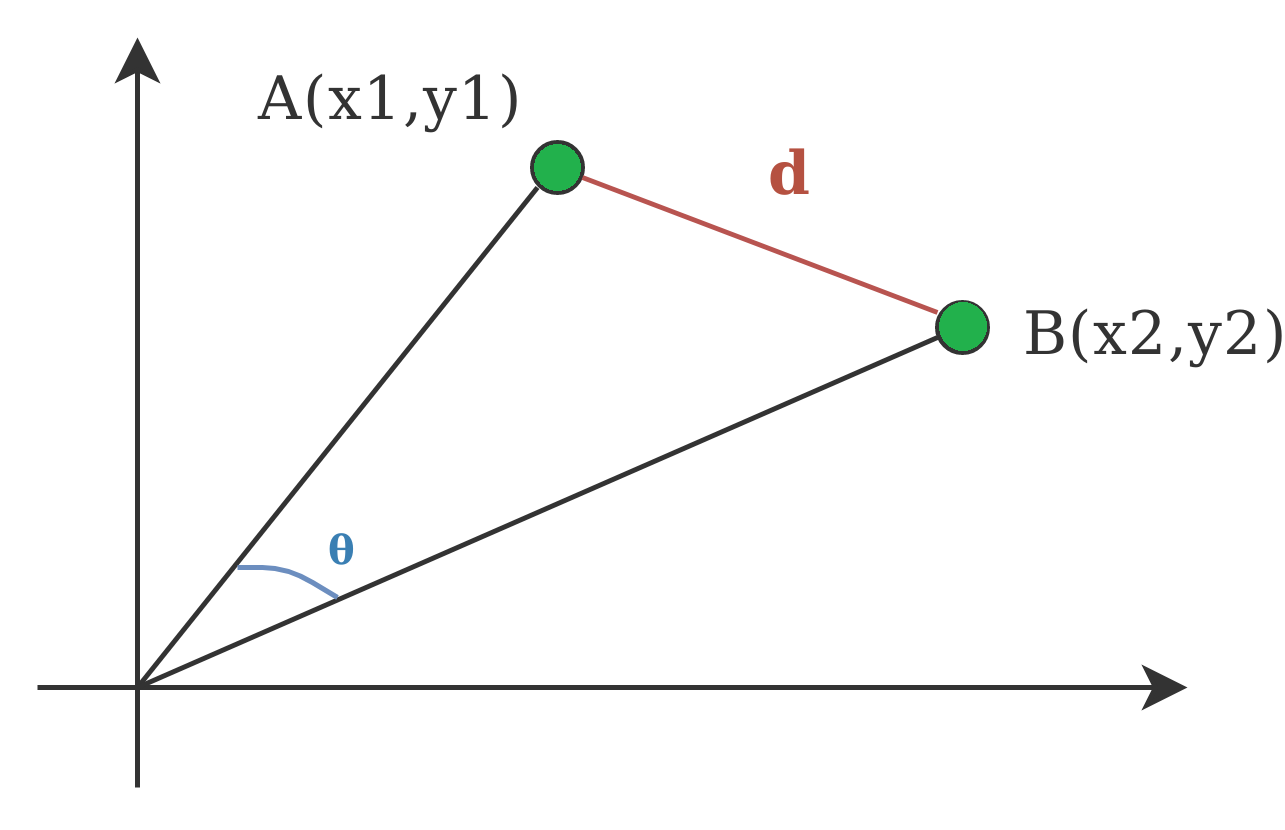

用于聚类的余弦距离度量确定由以下公式给出的两个向量之间的角度的余弦。

![]()

这里 ( theta ) 给出了两个向量之间的角度,A、B 是 n 维向量。