📌 相关文章

- Apache Spark-RDD

- Apache Spark RDD(1)

- Apache Spark RDD操作

- Apache Spark RDD操作(1)

- Apache Spark RDD操作(1)

- Apache Spark RDD操作

- Spark¢RDD

- Spark¢RDD(1)

- Apache Spark RDD持久性

- Apache Spark RDD持久性

- Apache Spark RDD持久性(1)

- Apache Spark RDD持久性(1)

- Apache Spark RDD共享变量

- Apache Spark RDD共享变量(1)

- Apache Spark RDD共享变量(1)

- Apache Spark RDD共享变量

- Apache Spark安装

- Apache Spark安装(1)

- Apache Spark安装

- Apache Spark-安装(1)

- Apache Spark-安装

- Apache Spark 的组件(1)

- Apache Spark组件(1)

- Apache Spark 的组件

- Apache Spark组件(1)

- Apache Spark组件

- Apache Spark组件

- Apache Spark教程

- Apache Spark教程(1)

📜 Apache Spark RDD

📅 最后修改于: 2020-12-27 02:36:09 🧑 作者: Mango

什么是RDD?

RDD(弹性分布式数据集)是Spark的核心抽象。它是元素的集合,分布在集群的各个节点上,因此我们可以对其执行各种并行操作。

有两种创建RDD的方法:

- 并行化驱动程序中的现有数据

- 引用外部存储系统中的数据集,例如共享文件系统,HDFS,HBase或提供Hadoop InputFormat的任何数据源。

并行集合

要创建并行化的集合,请在驱动程序中的现有集合上调用SparkContext的parallelize方法。复制集合的每个元素以形成可以并行操作的分布式数据集。

val info = Array(1, 2, 3, 4)

val distinfo = sc.parallelize(info)

现在,我们可以并行操作分布式数据集(distinfo),例如distinfo.reduce((a,b)=> a + b)。

外部数据集

在Spark中,可以从Hadoop支持的任何类型的存储源(例如HDFS,Cassandra,HBase甚至我们的本地文件系统)创建分布式数据集。 Spark提供了对文本文件, SequenceFiles和其他类型的Hadoop InputFormat的支持。

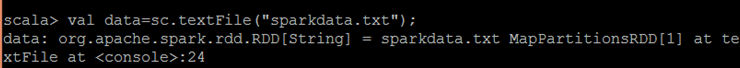

SparkContext的textFile方法可用于创建RDD的文本文件。此方法获取文件的URI(计算机上的本地路径或hdfs://)并读取文件的数据。

现在,我们可以通过数据集操作来操作数据,例如,我们可以使用map并减少操作的总和,如下所示:data.map(s => s.length).reduce((a,b)= > a + b)。