为了理解机器学习以及深度学习背后的概念,线性代数原理至关重要。线性代数是数学的一个分支,它允许以简洁的方式定义和执行高维坐标和平面相互作用。它的主要重点是线性方程组。

在本文中,将讨论-

- 基本向量背后的想法?

- 基向量的定义

- 基向量的性质

- 给定空间的基础向量

- 从数据科学的角度来看很重要

基本向量背后的想法是什么?

因此,这里的想法如下:

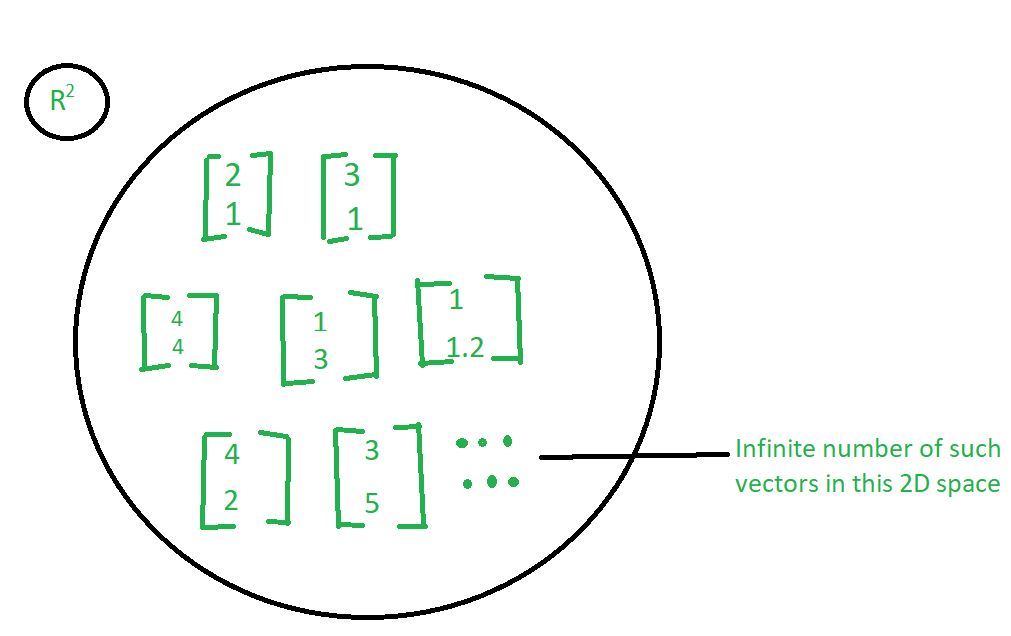

让我们考虑一个R平方的空间,这基本上意味着,我们正在研究2维的向量。这意味着如上图所示,这些向量中的每一个都有2个分量。我们可以采用许多向量。因此,将有无限数量的矢量,它们将在2维中。因此,关键是我们可以使用一些基本元素然后使用这些基本元素的某种组合来表示所有这些向量。

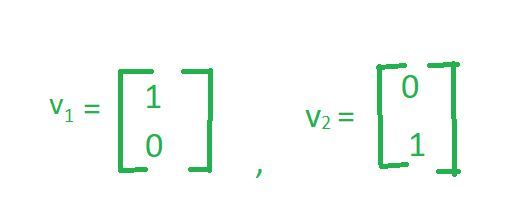

现在,让我们考虑2个向量

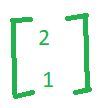

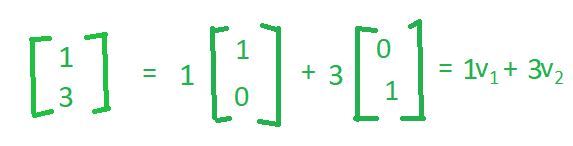

现在,如果您取R平方空间中给定的任何矢量,那么我们说取

我们可以将该向量写为该向量加该向量的某种线性组合,如下所示。

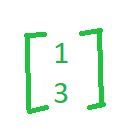

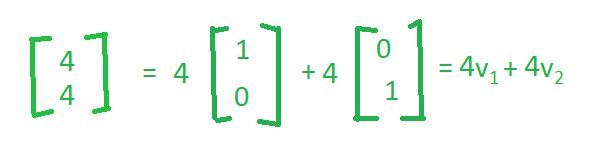

同样地,如果您服用

我们还可以将该向量写为该向量加该向量的某种线性组合,如下所示。

相似地,

这对于您在此空间中拥有的任何向量都是正确的。

因此,从某种意义上讲,我们所说的是这两个向量( v1和v2 )表征了空间,或者它们构成了空间的基础,并且该空间中的任何向量都可以简单地写成这两个向量的线性组合。现在您会注意到,线性组合实际上是数字本身。因此,例如,如果我想将vector(2,1)写成vector(1,0)和vector(0,1 )的线性组合,则标量倍数是2和1 ,这与vector( 4、4) ,依此类推。

因此,关键是当我们这里有无限数量的向量时,它们都可以作为仅2个向量的线性组合生成,并且在这里我们已经看到,这2个向量分别是vector(1,0)和vector(0, 1) 。现在,这两个向量被称为整个空间的基础。

基本向量的定义:如果可以将给定空间中的每个向量写成某些向量的线性组合,并且这些向量彼此独立,则我们将它们称为该给定空间的基本向量。

基向量的属性:

- 基向量必须彼此线性独立:

如果将v1乘以任何标量,我将永远无法获得向量v2。这证明v1和v2彼此线性独立。我们希望基本向量彼此线性独立,因为我们希望每个向量都基于此,以生成唯一信息。如果它们彼此依赖,那么此向量将不会带来任何独特的事物。 - 基本向量必须跨越整个空间:

“跨度”一词基本上意味着该空间中的任何向量,我都可以将其写成基本向量的线性组合,正如我们在前面的示例中看到的那样。 - 基向量不是唯一的:人们可以找到许多基向量集。唯一的条件是它们必须是线性独立的,并且应该跨越整个空间。因此,让我们通过采用与之前相同的示例来详细了解此属性。

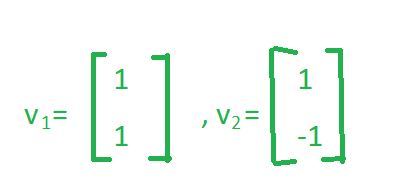

让我们考虑另外两个彼此线性独立的向量。

首先,我们必须检查这两个向量是否服从基向量的性质?

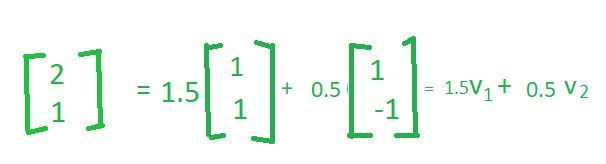

您会看到这两个向量彼此线性独立,因为将v1乘以永远无法获得向量v2的任何标量。因此,例如,如果我将v1乘以-1,我将得到vector(-1,-1) ,而不是vector(1,-1) 。为了验证第二个属性,让我们采用vector(2,1) 。现在,让我们看看是否可以将vector(2,1)表示为vector(1,1)和vector(1,-1)的线性组合。

因此,如果您对此进行研究,我们已经成功地将vector(2,1)表示为vector(1,1)和vector(1,-1)的线性组合。您可能会注意到,在前一种情况下,当我们使用vector(1,0)和vector(0,1)时,我们说这可以写成vector(1,0)的2倍和vector(0,1的1倍, 1) ;但是,数字现在已经改变了。尽管如此,我可以将其写为这两个基向量的线性组合。

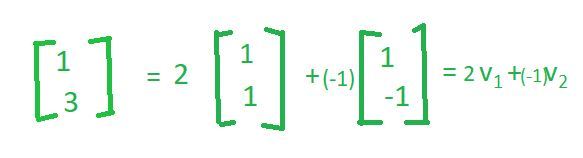

同样,如果采用vector(1,3)

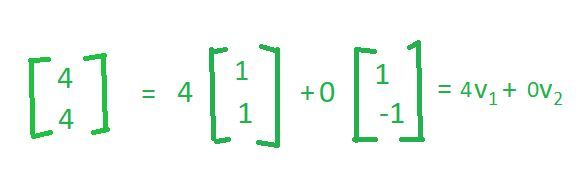

同样,如果采用vector(4,4)

因此,这是相同基础向量的另一线性组合。因此,我想在这里指出的重点是基向量不是唯一的。定义基向量的方法有很多种。但是,它们都具有相同的属性,即如果我有一组向量(称为基本向量),则这些向量必须彼此独立,并且它们应跨越整个空间。因此,该v1和v2也是R 2的基向量。

要记住的一点:

这里要注意的一个有趣的事情是,我们不能有2个具有不同数量向量的基集。我的意思是在上一个示例中,尽管基本向量是v1(1,0)和v2(0,1),但是只有2个向量。类似地,在这种情况下,基本向量是v1(1,1)和v2(1,-1) 。但是,仍然只有2个向量。因此,尽管您可能有许多基础向量集,但它们全部等同于每组中的向量数将是相同的,但它们不能不同。因此,请记住,对于相同的空间,不可能有2个基本集,其中一个带有n个向量,而另一个带有m个向量,这是不可能的。因此,如果它是相同空间的基本集合,则每个集合中的向量数应相同。

查找基础向量:

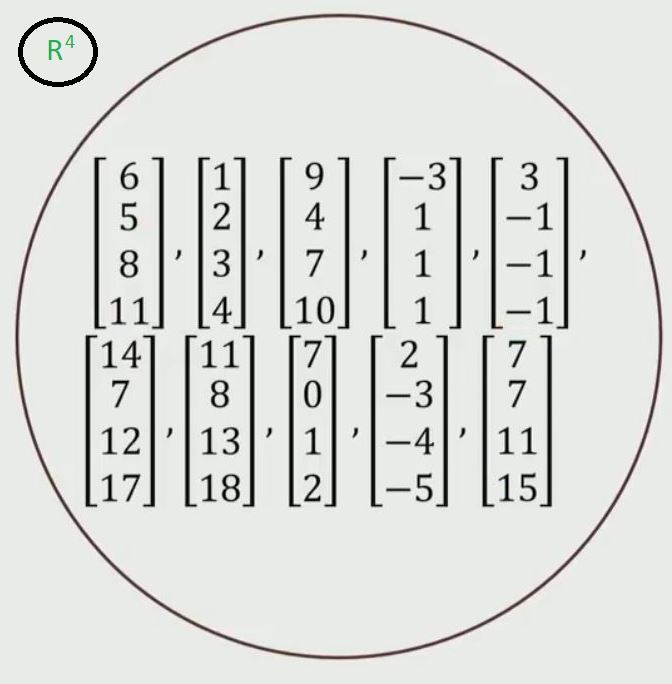

让我们以R 4空间为例。这实际上意味着这些向量中的每一个都有4个分量。

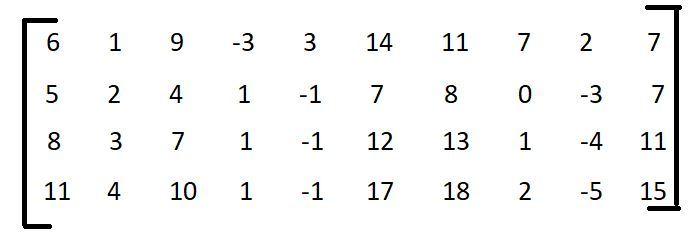

- 步骤1:要找到给定向量集的基础向量,请按如下所示以矩阵形式排列向量。

- 步骤2:找到此矩阵的等级。

如果您确定此矩阵的等级,它将为您提供线性独立列的数量。矩阵的等级将告诉我们,解释所有这些列的基本步骤是多少,我们需要多少列。因此,我们可以将其余的列生成为这些列的线性组合。要了解矩阵的等级,请参考此链接。因此,矩阵的秩为2。

- 第三步:

可以从上面的矩阵中选取任意两个独立的列作为基础向量。

解释:

如果矩阵的秩是1,那么我们只有1个基本向量;如果秩是2,则有2个基本向量;如果3则有3个基本向量,依此类推。在这种情况下,由于矩阵的秩为2,因此仅需要2个列向量即可表示该矩阵中的每一列。因此,基础集的大小为2。因此,我们可以在此处选择任意2个线性独立的列,然后将其作为基础向量。

因此,例如,我们可以选择v1(6、5、8、11)和v2(1、2、3、4),然后说这是所有这些列的基向量,或者我们可以选择v1(3, -1,-1,-1)和v2(7、7、11、15)等。我们可以选择任意两列,只要它们彼此线性独立,这就是我们从上面知道的基本向量不必唯一的原因。因此,我选择代表该数据的任意2个线性独立列。

从数据科学的角度来看很重要

现在,让我向您解释为什么从数据科学的角度来看,这种基向量概念非常重要。只要看一下前面的例子。我们有10个样本,我们想存储这10个样本,因为每个样本有4个数字,所以我们将存储4 x 10 = 40个数字。

现在,让我们假设对这10个样本进行相同的练习,然后发现我们只有2个基本向量,这将是该集合中的2个向量。我们可以做的是,我们可以存储这2个基向量,它们将是2 x 4 = 8个数字,并且对于其余8个样本,而不是存储所有样本以及每个样本中的所有数字,我们可以做的是对于每个样本,我们只能存储2个数字,这是我们将用来构造它的线性组合。因此,除了存储这4个数字之外,我们还可以简单地存储这2个常量,并且由于我们已经存储了基向量,因此,只要我们要对其进行重构,我们就可以简单地将第一个常量乘以v1并将其乘以第二个常量到v2,我们将获得此数字。

总而言之,

We store 2 basis vectors which give me: 4 x 2 = 8 numbers

And then for the remaining 8 samples, we simply store 2 constants e.g: 8 x 2 = 16 numbers

So, this would give us: 8 + 16 = 24 numbers

Hence instead of storing 4 x 10 = 40 numbers, we can store only 24 numbers, which is the approximately half reduction in number. And we will be able to reconstruct the whole data set by storing only 24 numbers.

因此,例如,如果您有一个30维向量,并且基向量仅为3,则可以看到数据存储方面的归约类型。因此,这是数据科学的一种观点。

为什么减少数据存储会从数据科学的角度受益?

从根本上表征数据的角度理解和表征数据非常重要。因此,您可以减少存储量,我们可以进行更智能的计算,还有许多其他原因导致我们想要这样做,

- 您可以标识此基础,以标识此数据之间的模型。

- 您可以确定数据降噪的依据。