人工神经网络的实现模型

1. 神经元的 McCulloch-Pitts 模型

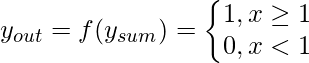

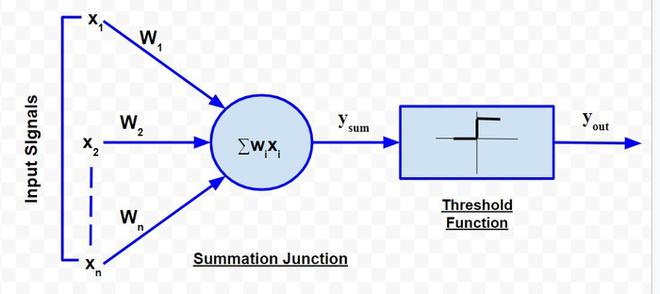

McCulloch-Pitts 神经模型是最早的 ANN 模型,它只有两种类型的输入——兴奋性和抑制性。兴奋性输入的权重为正,抑制性输入的权重为负。 McCulloch-Pitts 神经元的输入可以是 0 或 1。它有一个阈值函数作为激活函数。因此,如果输入y总和大于或等于给定阈值,则输出信号y out为 1,否则为 0。模型的图解表示如下:

麦卡洛克-皮茨模型

简单的 McCulloch-Pitts 神经元可用于设计逻辑运算。为此,连接权重需要与阈值函数(而不是激活函数的阈值)一起正确确定。为了更好地理解目的,让我考虑一个例子:

如果晴天或下雨,约翰会带伞。有四种给定的情况。我需要决定约翰什么时候带伞。情况如下:

- 第一种情况:不下雨,也不是晴天

- 场景二:不是下雨,而是晴天

- 第三种情况:下雨了,不是晴天

- 第四种情况:下雨天晴

为了使用 McCulloch-Pitts 神经模型分析情况,我可以考虑如下输入信号:

- X 1 :下雨了吗?

- X 2 : 晴天吗?

因此,这两种情况的值都可以是 0 或 1。我们可以使用权重 X 1和 X 2的值作为 1,使用阈值函数作为 1。因此,神经网络模型将如下所示:

这种情况的真值表将是: Situation x1 x2 ysum yout 1 0 0 0 0 2 0 1 1 1 3 1 0 1 1 4 1 1 2 1

所以,我可以这么说,

上面描述了针对该问题构建的真值表。从真值表中,我可以得出结论,在y out的值为 1 的情况下,John 需要带雨伞。因此,他需要在场景 2、3 和 4 中携带雨伞。

2. 罗森布拉特的感知器

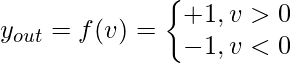

Rosenblatt 的感知器是围绕 McCulloch-Pitts 神经模型构建的。图解表示如下:

罗森布拉特的感知器

感知器接收一组输入 x 1 , x 2 ,....., x n 。线性组合器或加法器模式计算应用于突触的输入的线性组合,突触权重为 w 1 , w 2 ,……,w n 。然后,硬限制器检查结果和是正还是负。如果硬限制器节点的输入为正,则输出为+1,如果输入为负,则输出为-1。在数学上,硬限制器输入是:

![]()

然而,感知器包括一个可调整的值或偏差作为额外的权重 w 0 。这个额外的权重附加到一个虚拟输入 x 0 ,它被赋值为 1。这个考虑将上面的等式修改为:

输出由表达式决定:

感知器的目标是将一组输入分类为两类 c 1和 c 2 。这可以使用一个非常简单的决策规则来完成——如果感知器的输出即 y out为 +1,则将输入分配给 c 1 ,如果 y out为 -1,则分配给 c 2 。因此,对于一个 n 维信号空间,即“n”个输入信号的空间,最简单形式的感知器将有两个决策区域,类似于两个类别,由定义的超平面分隔:

![]()

因此,由变量 x 1和 x 2表示的两个输入信号,决策边界是一条直线,形式为:

![]() 要么

要么

![]()

因此,对于具有突触权重值 w 0 、w 1和 w 2的感知器,它们分别为 -2、1/2 和 1/4。线性决策边界将采用以下形式:

![]()

![]()

因此,如图所示,位于决策边界上方的任何点 (x, 1 x 2 ) 将被分配到类 c1,而位于边界下方的点将被分配到类 c2。

因此,我们看到对于具有线性可分类的数据集,感知器总是可以用来解决分类问题,使用决策线(对于 2 维空间)、决策平面(对于 3 维空间)或决策超平面(对于 n-维空间)。突触权重的适当值可以通过训练感知器来获得。然而,感知器正常工作的一个假设是这两个类应该是线性可分的,即这些类应该彼此充分分离。否则,如果类是非线性可分的,那么感知器就无法解决分类问题。

线性与非线性可分类

多层感知器:基本感知器非常适用于具有线性可分模式的数据集。但是,在实际情况下,这是一个理想的情况。这正是 Minsky 和 Papert 在 1969 年的工作中提出的观点。他们表明,即使是简单的 2 位 XOR,基本感知器也无法学习计算。那么,让我们了解一下原因。

考虑一个突出显示 2 位 XOR函数输出的真值表: x1 x2 x1 XOR x2 Class 1 1 0 c2 1 0 1 c1 0 1 1 c1 0 0 0 c2

数据不是线性可分的。只有弯曲的决策边界才能正确分离类。为了解决这个问题,另一种选择是使用两条决策边界线代替一条。

在 XOR函数输出中使用两条决策线进行分类

这是用于设计多层感知器模型的理念。该模型的主要亮点如下:

- 神经网络在输入和输出节点之间包含一个或多个中间层,这些中间层对输入和输出节点都是隐藏的

- 网络中的每个神经元都包含一个可微分的非线性激活函数。

- 每一层的神经元都与前一层的部分或全部神经元相连。

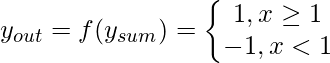

3. ADALINE 网络模型

自适应线性神经元 (ADALINE) 是斯坦福大学 Bernard Widrow 教授开发的早期单层人工神经网络。如下图所示,它只有输出神经元。输出值可以是 +1 或 -1。添加具有权重 w 0的偏置输入 x 0 (其中 x 0 =1)。激活函数是这样的,如果加权和为正或 0,则输出为 1,否则为 -1。形式上我可以这么说,

![]()

ADALINE 网络采用的监督学习算法称为最小均方 (LMS)或DELTA 规则。将多个 ADALINE 组合在一起的网络称为MADALINE(多 ADALINE) 。 MEADALINE 网络可用于解决与非线性可分性相关的问题。