Log Odds 在 Logistic 回归中的作用

先决条件:对数赔率,逻辑回归

NOTE: It is advised to go through the prerequisite topics to have a clear understanding of this article.

对数赔率在逻辑回归中起着重要作用,因为它将 LR 模型从基于概率的模型转换为基于似然的模型。概率和对数赔率都有自己的一组属性,但是对数赔率使解释输出更容易。因此,使用对数赔率比概率略有优势。

在深入了解逻辑回归的细节之前,让我们简要了解一下什么是赔率。

赔率:简单地说,赔率是成功的机会除以失败的机会。它以比率的形式表示。 (如下面的等式所示)

![]()

where,

p -> success odds

1-p -> failure odds对数赔率的逻辑回归

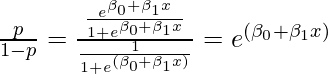

现在,让我们进入逻辑回归中对数赔率的参与背后的数学。在逻辑回归中,成功对应自变量的几率由下式给出:

![]()

where,

p -> odds of success

β0, β1 -> assigned weights

x -> independent variable因此,在这种情况下失败的几率将通过以下方式给出:

![]()

因此,优势比定义为:

现在,如对数优势文章中所述,我们采用优势比的对数来获得结果的对称性。因此,两边取日志给出:

![]()

这是逻辑回归的一般方程。现在,在逻辑模型中,LHS 包含由 RHS 给出的优势比的对数,涉及权重和自变量的线性组合。

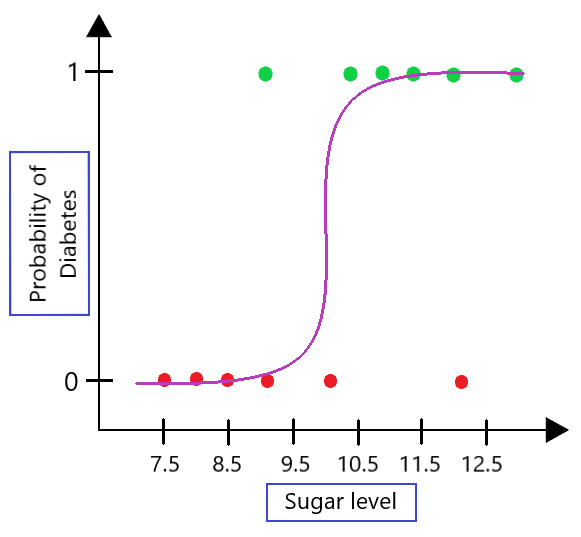

图形直觉

一世。逻辑回归中基于概率的输出问题

让我们考虑一个例子。比如说,我们建立了一个逻辑回归模型来根据一个人的血糖水平来确定他们患糖尿病的概率。这个情节看起来像:(见图1)

图 1:LR 模型图

问题仍然是模型的输出只是基于上图的二进制。为了解决这个问题,我们使用逻辑回归中存在的对数几率的概念。

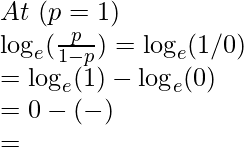

ii.解决方案:转换输出

为了解决上面讨论的问题,我们将基于概率的输出转换为基于对数几率的输出。 (如下面的等式所示)

![]()

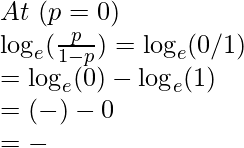

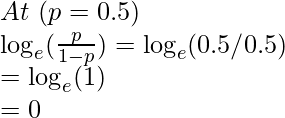

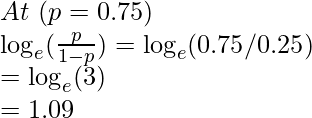

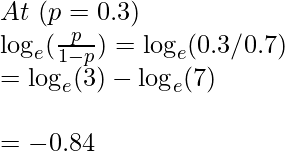

让我们假设 p 的随机值,看看 y 轴是如何变换的。

一种。边界值

因此,y 轴的定义域为: (-∞, ∞)

湾中值

所以,在 p = 0.5 -> log (odds) = y = 0 。

C。随机值

因此,在 p > 0.5 -> 我们得到范围(0, ∞)内的 log(odds) 值

并且在 p < 0.5 -> 我们得到范围(-∞, 0)内的 log(odds) 值

如果我们将这些值映射到转换后的图上,它看起来像:(如图 2 所示)

图 2:转换后的 LR 图

基于斜率 (m) 和截距 (c) 的值,我们可以轻松解释模型并获得非二进制确定性输出。这是逻辑回归中对数赔率的力量。

当我们查看非二进制输出时,通常称为Logit函数数赔率在 Logistic 回归模型中使用。这就是逻辑回归能够同时作为回归和分类模型的方式。如有任何疑问/疑问,请在下方评论。