- Hadoop 和 MapReduce 的区别(1)

- Hadoop 和 MapReduce 的区别

- MapReduce-Hadoop管理(1)

- MapReduce-Hadoop管理

- MapReduce-Hadoop实施

- MapReduce-Hadoop实施(1)

- Hadoop MapReduce – 数据流

- Hadoop MapReduce – 数据流(1)

- Hadoop – MapReduce 中的映射器(1)

- Hadoop – MapReduce 中的映射器

- Hadoop MapReduce 中的分布式缓存

- Hadoop MapReduce 中的分布式缓存(1)

- 如何在 MapReduce Hadoop 中执行字符计数程序?(1)

- 如何在 MapReduce Hadoop 中执行字符计数程序?

- mapreduce java (1)

- Hadoop – 带有示例的 MapReduce 的 mrjob Python库

- Hadoop – 带有示例的 MapReduce 的 mrjob Python库(1)

- MapReduce-安装(1)

- MapReduce-安装

- Hadoop-流

- Hadoop-流(1)

- hadoop 流 (1)

- MapReduce API

- MapReduce-API

- MapReduce API(1)

- MapReduce-算法

- mapreduce java - 任何代码示例

- MapReduce教程(1)

- MapReduce教程(1)

📅 最后修改于: 2020-12-01 06:43:04 🧑 作者: Mango

MapReduce是一个框架,通过该框架,我们可以编写应用程序以可靠的方式在大型商用硬件集群上并行处理大量数据。

什么是MapReduce?

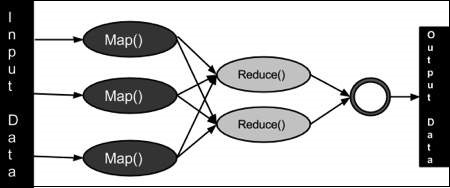

MapReduce是基于Java的分布式计算的处理技术和程序模型。 MapReduce算法包含两个重要任务,即Map和Reduce。 Map获取一组数据并将其转换为另一组数据,其中各个元素被分解为元组(键/值对)。其次,reduce任务,它将地图的输出作为输入,并将这些数据元组合并为较小的元组集。正如名称MapReduce的顺序所暗示的那样,reduce任务始终在映射作业之后执行。

MapReduce的主要优点在于,它易于在多个计算节点上扩展数据处理的规模。在MapReduce模型下,数据处理原语称为映射器和简化器。分解的数据处理应用到映射器和减速器有时平凡的。但是,一旦我们以MapReduce形式编写了一个应用程序,就可以将应用程序扩展为在集群中的数百台,数千台甚至数万台计算机上运行,这仅仅是配置上的更改。这种简单的可伸缩性吸引了许多程序员使用MapReduce模型。

算法

-

通常,MapReduce范例基于将计算机发送到数据所在的位置!

-

MapReduce程序分三个阶段执行,即地图阶段,混洗阶段和缩小阶段。

-

Map阶段-Map或Mapper的工作是处理输入数据。通常,输入数据采用文件或目录的形式,并存储在Hadoop文件系统(HDFS)中。输入文件逐行传递到映射器函数。映射器处理数据并创建几个小数据块。

-

Reduce阶段-此阶段是Shuffle阶段和Reduce阶段的组合。 Reducer的工作是处理来自映射器的数据。处理后,它将产生一组新的输出,这些输出将存储在HDFS中。

-

-

在MapReduce作业期间,Hadoop将Map和Reduce任务发送到集群中的相应服务器。

-

该框架管理数据传递的所有细节,例如发布任务,验证任务完成以及在节点之间的集群周围复制数据。

-

大多数计算都在本地磁盘上有数据的节点上进行,从而减少了网络流量。

-

完成给定任务后,集群将收集并减少数据以形成适当的结果,然后将其发送回Hadoop服务器。

输入和输出(Java透视图)

MapReduce框架对

键和值类应由框架以串行方式进行,因此需要实现Writable接口。此外,关键类必须实现Writable-Comparable接口,以利于框架排序。 MapReduce作业的输入和输出类型-(输入)

| Input | Output | |

|---|---|---|

| Map | list ( |

|

| Reduce | list ( |

术语

-

PayLoad-应用程序实现Map和Reduce函数,并构成工作的核心。

-

映射器-映射器将输入键/值对映射到一组中间键/值对。

-

NamedNode-管理Hadoop分布式文件系统(HDFS)的节点。

-

DataNode-在进行任何处理之前预先呈现数据的节点。

-

MasterNode -JobTracker运行并接收来自客户端的作业请求的节点。

-

SlaveNode-运行Map和Reduce程序的节点。

-

JobTracker-计划作业并跟踪分配给Task Tracker的作业。

-

任务跟踪器-跟踪任务并将状态报告给JobTracker。

-

Job-程序是跨数据集的Mapper和Reducer的执行。

-

任务-在数据切片上执行Mapper或Reducer。

-

任务尝试-尝试在SlaveNode上执行任务的特定实例。

示例场景

以下是有关组织的电力消耗的数据。它包含每月的用电量和不同年份的年平均值。

| Jan | Feb | Mar | Apr | May | Jun | Jul | Aug | Sep | Oct | Nov | Dec | Avg | |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 1979 | 23 | 23 | 2 | 43 | 24 | 25 | 26 | 26 | 26 | 26 | 25 | 26 | 25 |

| 1980 | 26 | 27 | 28 | 28 | 28 | 30 | 31 | 31 | 31 | 30 | 30 | 30 | 29 |

| 1981 | 31 | 32 | 32 | 32 | 33 | 34 | 35 | 36 | 36 | 34 | 34 | 34 | 34 |

| 1984 | 39 | 38 | 39 | 39 | 39 | 41 | 42 | 43 | 40 | 39 | 38 | 38 | 40 |

| 1985 | 38 | 39 | 39 | 39 | 39 | 41 | 41 | 41 | 00 | 40 | 39 | 39 | 45 |

如果将上述数据作为输入,我们必须编写应用程序进行处理并产生结果,例如查找最大使用年限,最小使用年限等。对于记录数量有限的程序员来说,这是一次过渡。他们将简单地编写逻辑以产生所需的输出,并将数据传递给编写的应用程序。

但是,请考虑代表该州成立以来所有大型行业的用电量的数据。

当我们编写应用程序来处理此类批量数据时,

-

他们将花费很多时间来执行。

-

当我们将数据从源移动到网络服务器等时,网络流量将会很大。

为了解决这些问题,我们有MapReduce框架。

输入数据

以上数据另存为sample.txt,并作为输入提供。输入文件如下所示。

1979 23 23 2 43 24 25 26 26 26 26 25 26 25

1980 26 27 28 28 28 30 31 31 31 30 30 30 29

1981 31 32 32 32 33 34 35 36 36 34 34 34 34

1984 39 38 39 39 39 41 42 43 40 39 38 38 40

1985 38 39 39 39 39 41 41 41 00 40 39 39 45

范例程序

下面给出的是使用MapReduce框架的示例数据程序。

package hadoop;

import java.util.*;

import java.io.IOException;

import java.io.IOException;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.conf.*;

import org.apache.hadoop.io.*;

import org.apache.hadoop.mapred.*;

import org.apache.hadoop.util.*;

public class ProcessUnits {

//Mapper class

public static class E_EMapper extends MapReduceBase implements

Mapper /*Output value Type*/

{

//Map function

public void map(LongWritable key, Text value,

OutputCollector output,

Reporter reporter) throws IOException {

String line = value.toString();

String lasttoken = null;

StringTokenizer s = new StringTokenizer(line,"\t");

String year = s.nextToken();

while(s.hasMoreTokens()) {

lasttoken = s.nextToken();

}

int avgprice = Integer.parseInt(lasttoken);

output.collect(new Text(year), new IntWritable(avgprice));

}

}

//Reducer class

public static class E_EReduce extends MapReduceBase implements Reducer< Text, IntWritable, Text, IntWritable > {

//Reduce function

public void reduce( Text key, Iterator values,

OutputCollector output, Reporter reporter) throws IOException {

int maxavg = 30;

int val = Integer.MIN_VALUE;

while (values.hasNext()) {

if((val = values.next().get())>maxavg) {

output.collect(key, new IntWritable(val));

}

}

}

}

//Main function

public static void main(String args[])throws Exception {

JobConf conf = new JobConf(ProcessUnits.class);

conf.setJobName("max_eletricityunits");

conf.setOutputKeyClass(Text.class);

conf.setOutputValueClass(IntWritable.class);

conf.setMapperClass(E_EMapper.class);

conf.setCombinerClass(E_EReduce.class);

conf.setReducerClass(E_EReduce.class);

conf.setInputFormat(TextInputFormat.class);

conf.setOutputFormat(TextOutputFormat.class);

FileInputFormat.setInputPaths(conf, new Path(args[0]));

FileOutputFormat.setOutputPath(conf, new Path(args[1]));

JobClient.runJob(conf);

}

}

将以上程序另存为ProcessUnits.java。程序的编译和执行如下所述。

程序单元程序的编译和执行

让我们假设我们位于Hadoop用户的主目录中(例如/ home / hadoop)。

请按照下面给出的步骤来编译和执行上述程序。

第1步

以下命令将创建一个目录来存储已编译的Java类。

$ mkdir units

第2步

下载Hadoop-core-1.2.1.jar,该文件用于编译和执行MapReduce程序。访问以下链接mvnrepository.com以下载jar。让我们假设下载的文件夹是/ home / hadoop /。

第三步

以下命令用于编译ProcessUnits.java程序并为该程序创建jar。

$ javac -classpath hadoop-core-1.2.1.jar -d units ProcessUnits.java

$ jar -cvf units.jar -C units/ .

第4步

以下命令用于在HDFS中创建输入目录。

$HADOOP_HOME/bin/hadoop fs -mkdir input_dir

第5步

以下命令用于在HDFS的输入目录中复制名为sample.txt的输入文件。

$HADOOP_HOME/bin/hadoop fs -put /home/hadoop/sample.txt input_dir

第6步

以下命令用于验证输入目录中的文件。

$HADOOP_HOME/bin/hadoop fs -ls input_dir/

步骤7

以下命令用于通过从输入目录获取输入文件来运行Eleunit_max应用程序。

$HADOOP_HOME/bin/hadoop jar units.jar hadoop.ProcessUnits input_dir output_dir

等待一段时间,直到文件执行完毕。执行后,如下所示,输出将包含输入分割数,Map任务数,reduce任务数等。

INFO mapreduce.Job: Job job_1414748220717_0002

completed successfully

14/10/31 06:02:52

INFO mapreduce.Job: Counters: 49

File System Counters

FILE: Number of bytes read = 61

FILE: Number of bytes written = 279400

FILE: Number of read operations = 0

FILE: Number of large read operations = 0

FILE: Number of write operations = 0

HDFS: Number of bytes read = 546

HDFS: Number of bytes written = 40

HDFS: Number of read operations = 9

HDFS: Number of large read operations = 0

HDFS: Number of write operations = 2 Job Counters

Launched map tasks = 2

Launched reduce tasks = 1

Data-local map tasks = 2

Total time spent by all maps in occupied slots (ms) = 146137

Total time spent by all reduces in occupied slots (ms) = 441

Total time spent by all map tasks (ms) = 14613

Total time spent by all reduce tasks (ms) = 44120

Total vcore-seconds taken by all map tasks = 146137

Total vcore-seconds taken by all reduce tasks = 44120

Total megabyte-seconds taken by all map tasks = 149644288

Total megabyte-seconds taken by all reduce tasks = 45178880

Map-Reduce Framework

Map input records = 5

Map output records = 5

Map output bytes = 45

Map output materialized bytes = 67

Input split bytes = 208

Combine input records = 5

Combine output records = 5

Reduce input groups = 5

Reduce shuffle bytes = 6

Reduce input records = 5

Reduce output records = 5

Spilled Records = 10

Shuffled Maps = 2

Failed Shuffles = 0

Merged Map outputs = 2

GC time elapsed (ms) = 948

CPU time spent (ms) = 5160

Physical memory (bytes) snapshot = 47749120

Virtual memory (bytes) snapshot = 2899349504

Total committed heap usage (bytes) = 277684224

File Output Format Counters

Bytes Written = 40

步骤8

以下命令用于验证输出文件夹中的结果文件。

$HADOOP_HOME/bin/hadoop fs -ls output_dir/

步骤9

以下命令用于查看Part-00000文件中的输出。该文件由HDFS生成。

$HADOOP_HOME/bin/hadoop fs -cat output_dir/part-00000

以下是MapReduce程序生成的输出。

1981 34

1984 40

1985 45

第10步

以下命令用于将输出文件夹从HDFS复制到本地文件系统以进行分析。

$HADOOP_HOME/bin/hadoop fs -cat output_dir/part-00000/bin/hadoop dfs get output_dir /home/hadoop

重要命令

所有Hadoop命令均由$ HADOOP_HOME / bin / hadoop命令调用。在不带任何参数的情况下运行Hadoop脚本会打印所有命令的描述。

用法-hadoop [–config confdir]命令

下表列出了可用的选项及其说明。

| Sr.No. | Option & Description |

|---|---|

| 1 |

namenode -format Formats the DFS filesystem. |

| 2 |

secondarynamenode Runs the DFS secondary namenode. |

| 3 |

namenode Runs the DFS namenode. |

| 4 |

datanode Runs a DFS datanode. |

| 5 |

dfsadmin Runs a DFS admin client. |

| 6 |

mradmin Runs a Map-Reduce admin client. |

| 7 |

fsck Runs a DFS filesystem checking utility. |

| 8 |

fs Runs a generic filesystem user client. |

| 9 |

balancer Runs a cluster balancing utility. |

| 10 |

oiv Applies the offline fsimage viewer to an fsimage. |

| 11 |

fetchdt Fetches a delegation token from the NameNode. |

| 12 |

jobtracker Runs the MapReduce job Tracker node. |

| 13 |

pipes Runs a Pipes job. |

| 14 |

tasktracker Runs a MapReduce task Tracker node. |

| 15 |

historyserver Runs job history servers as a standalone daemon. |

| 16 |

job Manipulates the MapReduce jobs. |

| 17 |

queue Gets information regarding JobQueues. |

| 18 |

version Prints the version. |

| 19 |

jar Runs a jar file. |

| 20 |

distcp Copies file or directories recursively. |

| 21 |

distcp2 DistCp version 2. |

| 22 |

archive -archiveName NAME -p Creates a hadoop archive. |

| 23 |

classpath Prints the class path needed to get the Hadoop jar and the required libraries. |

| 24 |

daemonlog Get/Set the log level for each daemon |

如何与MapReduce作业进行交互

用法-Hadoop作业[GENERIC_OPTIONS]

以下是Hadoop作业中可用的通用选项。

| Sr.No. | GENERIC_OPTION & Description |

|---|---|

| 1 |

-submit Submits the job. |

| 2 |

-status Prints the map and reduce completion percentage and all job counters. |

| 3 |

-counter Prints the counter value. |

| 4 |

-kill Kills the job. |

| 5 |

-events Prints the events’ details received by jobtracker for the given range. |

| 6 |

-history [all] Prints job details, failed and killed tip details. More details about the job such as successful tasks and task attempts made for each task can be viewed by specifying the [all] option. |

| 7 |

-list[all] Displays all jobs. -list displays only jobs which are yet to complete. |

| 8 |

-kill-task Kills the task. Killed tasks are NOT counted against failed attempts. |

| 9 |

-fail-task Fails the task. Failed tasks are counted against failed attempts. |

| 10 |

-set-priority Changes the priority of the job. Allowed priority values are VERY_HIGH, HIGH, NORMAL, LOW, VERY_LOW |

查看工作状态

$ $HADOOP_HOME/bin/hadoop job -status

e.g.

$ $HADOOP_HOME/bin/hadoop job -status job_201310191043_0004

查看作业输出目录的历史记录

$ $HADOOP_HOME/bin/hadoop job -history

e.g.

$ $HADOOP_HOME/bin/hadoop job -history /user/expert/output

杀死工作

$ $HADOOP_HOME/bin/hadoop job -kill

e.g.

$ $HADOOP_HOME/bin/hadoop job -kill job_201310191043_0004